Cas pratiques

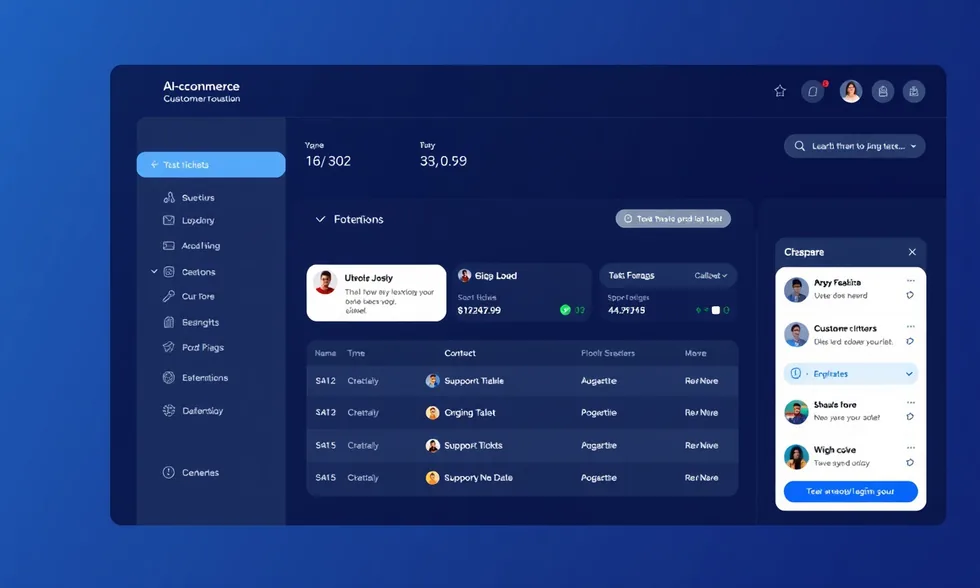

Étude de cas : e-commerçant automatise 95% des tickets SAV

Comment une boutique e-commerce de 2,5M€ CA a automatisé 95% de son service client avec un agent IA. Zéro réponse manuelle pour les demandes courantes, CSAT +18 points.

Flowise et Langflow sont aujourd’hui les deux références open-source pour créer des chatbots IA et des pipelines RAG sans écrire de code. Les deux permettent de connecter des LLM (GPT-4o, Claude, Mistral, Llama), de brancher des bases de connaissances et de déployer une API en quelques minutes. Mais leurs choix de conception diffèrent radicalement — et le mauvais choix peut vous coûter plusieurs semaines de reconfigurations.

Ce comparatif s’appuie sur une utilisation terrain des deux outils dans des projets clients PME françaises.

Flowise propose une interface canvas entièrement visuelle. Vous glissez des nœuds, vous les connectez, vous configurez les paramètres directement dans l’interface. Le paradigme est celui du no-code pur : aucune ligne de code n’est requise pour construire un chatbot fonctionnel avec mémoire de conversation et base de connaissances.

La prise en main est rapide. Un responsable des opérations sans profil technique peut construire son premier chatbot en 2 à 3 heures. La documentation est claire et des templates préconstruits couvrent les cas d’usage courants (chatbot SAV, agent de recherche documentaire, assistant FAQ).

Langflow adopte une approche similaire (canvas visuel, nœuds), mais expose davantage de paramètres techniques. Les nœuds sont plus granulaires, ce qui offre plus de contrôle — mais rend l’interface plus dense. Un utilisateur non-technique aura besoin de 1 à 2 jours pour atteindre le même niveau de confort qu’avec Flowise.

En revanche, Langflow brille pour les architectures complexes : workflows multi-agents, orchestration conditionnelle, gestion d’états avancée. Si votre besoin dépasse le chatbot simple, cette complexité devient un avantage.

Bon à savoir : Les deux outils proposent une interface en anglais uniquement. Aucune version française n’est disponible à ce jour. Pour des équipes non-anglophones, prévoyez un temps de formation supplémentaire ou une documentation interne traduite.

Les deux outils supportent les principaux fournisseurs de modèles de langage :

| Fournisseur | Flowise | Langflow |

|---|---|---|

| OpenAI (GPT-4o, o3) | ✅ Natif | ✅ Natif |

| Anthropic (Claude 3.5/4) | ✅ Natif | ✅ Natif |

| Mistral AI | ✅ Natif | ✅ Natif |

| Meta Llama (via Ollama) | ✅ Natif | ✅ Natif |

| Google Gemini | ✅ Natif | ✅ Natif |

| Modèles custom (API OpenAI-compatible) | ✅ | ✅ |

| Groq | ✅ | ✅ |

| Azure OpenAI | ✅ Natif | ✅ Natif |

Sur ce point, les deux outils sont comparables. La différence réside dans la facilité de configuration : Flowise simplifie la connexion aux providers avec des formulaires guidés, là où Langflow demande parfois de saisir manuellement les paramètres d’endpoint.

Le RAG (Retrieval-Augmented Generation) permet d’alimenter votre chatbot avec vos propres documents — manuels internes, FAQ, fiches produits, contrats. C’est souvent le cœur du projet pour les PME.

Flowise propose un pipeline RAG visuel complet : chargement de documents (PDF, Word, URL, Notion, Google Drive), découpage en chunks, création d’embeddings, stockage dans une base vectorielle, puis interrogation par le LLM. Le tout en glisser-déposer.

Les vector stores supportés nativement : Pinecone, Qdrant, Weaviate, Chroma, PGVector, Supabase. Pour une PME qui démarre, Chroma en local ou Qdrant self-hosted couvrent 95 % des besoins.

Langflow offre davantage de contrôle sur chaque étape du pipeline RAG. Vous pouvez ajuster finement les stratégies de chunking, les méthodes de re-ranking, les filtres de recherche hybride. Pour des cas complexes (documents hétérogènes, questions multi-sources, contexte très long), cette granularité fait la différence.

En revanche, cette flexibilité a un prix : la configuration initiale est plus longue et requiert de comprendre les concepts sous-jacents (embeddings, cosine similarity, k-NN).

Astuce AutomateIA : Pour une base documentaire inférieure à 500 documents, Flowise avec Chroma en local est suffisant et évite la complexité d’une base vectorielle cloud. Au-delà de 2 000 documents ou avec des mises à jour fréquentes, nous recommandons Qdrant ou PGVector pour la performance.

Nos experts analysent votre cas d’usage, vos contraintes techniques et votre budget pour vous recommander l’architecture la plus adaptée — avec une estimation de coût déploiement.

🤖 Obtenir mon audit chatbot gratuit

Flowise self-hosted : installation simple via npm ou Docker. Un VPS à 10-15 euros/mois (2 Go RAM) suffit pour la plupart des projets PME. La documentation d’installation est parmi les plus claires de l’écosystème open-source IA.

Flowise cloud : disponible depuis 2024 sur flowiseai.com. Plans à partir de 35 USD/mois pour une utilisation professionnelle. L’hébergement est aux États-Unis — point à vérifier selon vos contraintes RGPD.

Langflow self-hosted : installation via pip (Python) ou Docker. Légèrement plus complexe que Flowise car Langflow est une application Python (FastAPI backend + React frontend). Nécessite Python 3.10+ et environ 3-4 Go RAM pour un usage fluide.

Langflow cloud (DataStax Langflow) : hébergé sur infrastructure DataStax, disponible depuis 2024. Plans à partir de 39 USD/mois. Avantage : support professionnel inclus et intégration native avec AstraDB (vector store).

Attention RGPD : Les deux versions cloud hébergent les données aux États-Unis. Pour des données clients ou des documents sensibles, le self-hosting sur un serveur européen est la seule option conforme. Le self-hosting Flowise sur un VPS OVH ou Scaleway (France) résout ce problème pour moins de 20 euros/mois.

Flowise génère automatiquement une API REST pour chaque chatflow créé. L’endpoint est immédiatement utilisable depuis n’importe quelle application (site web, CRM, application mobile). Un widget de chatbot intégrable en une ligne de code JavaScript est fourni nativement — ce qui le rend particulièrement adapté aux déploiements sur site web.

Intégrations disponibles : Zapier, Make, N8N via webhook HTTP. Des connecteurs natifs existent pour Slack, Teams, Telegram.

Langflow propose également une API REST et une API WebSocket pour les applications temps réel. La différence : Langflow expose davantage de paramètres dans ses endpoints (gestion de sessions, streaming token-by-token), ce qui le rend plus adapté aux développeurs qui intègrent le chatbot dans une application custom.

L’intégration avec des outils no-code comme Make ou N8N est possible mais demande plus de configuration qu’avec Flowise.

| Critère | Flowise | Langflow |

|---|---|---|

| Open source | ✅ MIT License | ✅ MIT License |

| Self-hosted gratuit | ✅ Illimité | ✅ Illimité |

| Cloud starter | 35 USD/mois | 39 USD/mois |

| Support professionnel | Via cloud ou communauté | Via DataStax (cloud) |

| VPS recommandé (self-hosted) | 10-15 €/mois | 15-20 €/mois |

| Coût total self-hosted (hors LLM) | ~150-180 €/an | ~180-240 €/an |

Les deux outils sont économiquement accessibles. Le vrai coût variable est celui des appels LLM (OpenAI, Anthropic, etc.) qui dépend du volume de conversations. Pour un chatbot PME traitant 500 à 2 000 questions/mois avec GPT-4o mini, comptez entre 5 et 30 USD/mois de tokens.

Flowise dispose d’une communauté très active sur GitHub (plus de 35 000 étoiles en 2026) et d’un Discord officiel réactif. La documentation est régulièrement mise à jour et les templates communautaires couvrent la plupart des cas d’usage courants.

Langflow bénéficie du soutien de DataStax, ce qui lui assure une pérennité commerciale plus robuste et un support professionnel payant pour les entreprises. Sa communauté GitHub est également très active (plus de 40 000 étoiles en 2026). L’outil est maintenu par une équipe dédiée avec des releases régulières.

Flowise s’impose dans ces situations :

Un exemple concret : une agence immobilière que nous accompagnons a déployé un chatbot Flowise connecté à sa base de biens et à ses FAQ en 4 jours. Le chatbot qualifie les prospects entrants 24h/24 et les route vers le bon conseiller. Résultat : 30 % de leads mieux qualifiés et 6 heures/semaine économisées pour l’équipe commerciale.

Langflow est le bon choix dans ces situations :

Posez-vous ces trois questions pour décider :

1. Qui va maintenir le chatbot au quotidien ? Si c’est une personne sans profil technique (responsable SAV, office manager, dirigeant) → Flowise. Si c’est un développeur ou un profil technique → les deux conviennent, Langflow offre plus de souplesse.

2. Quelle est la complexité de votre cas d’usage ? Chatbot FAQ, assistant documentation, qualification leads → Flowise suffit largement. Multi-agents, logique conditionnelle avancée, intégration dans une application existante → Langflow.

3. Avez-vous des contraintes RGPD fortes ? Dans les deux cas, optez pour le self-hosting sur un serveur européen. Les deux outils sont équivalents sur ce point.

Non, pas directement. Les formats de configuration sont incompatibles. Une migration implique de recréer les flux dans l’autre outil, ce qui prend 1 à 2 jours selon la complexité. C’est une raison de plus pour bien choisir dès le départ.

Les deux sont open-source et gratuits pour un usage self-hosted. Le coût réel provient de l’infrastructure (VPS : 10-20 euros/mois) et des appels LLM (variable selon le volume). Les versions cloud sont payantes à partir de 35-39 USD/mois.

D’après les retours terrain de nos consultants AutomateIA, Flowise est plus fréquemment adopté par les PME françaises pour sa facilité de prise en main. Langflow est davantage choisi par les équipes avec un développeur interne ou des projets plus complexes.

Oui. Les deux supportent nativement Mistral AI, qui est l’un des modèles préférés pour les projets PME françaises soucieuses de la souveraineté des données. Mistral propose également des modèles self-hosted (via Ollama) pour un contrôle total sur les traitements.

Un minimum oui. Le “system prompt” — l’instruction qui définit le comportement de votre chatbot — détermine 60 % de la qualité des réponses. Nous recommandons de consacrer 2 à 4 heures à l’affinage du system prompt avant de mettre un chatbot en production.

Flowise est l’outil de référence pour les PME qui veulent un chatbot IA opérationnel rapidement, sans compétences techniques, avec un coût minimal. Langflow est le choix des équipes qui ont besoin de contrôle, de flexibilité et d’architectures plus élaborées.

Dans 80 % des cas d’usage PME que nous rencontrons, Flowise répond au besoin. Mais si votre projet implique des agents multiples, des pipelines documentaires complexes ou une intégration applicative poussée, Langflow vaut la courbe d’apprentissage supplémentaire.

Pour les cas les plus complexes, une architecture hybride — Flowise pour les chatbots simples, Langflow ou du code custom pour les agents métier — est souvent la solution la plus efficace.

🤖 Créer mon chatbot IA avec AutomateIA

🚀

Faites découvrir nos conseils experts à votre réseau

💡 Partagez nos conseils d'experts avec votre réseau professionnel

Passez à l'action

Audit gratuit en 48h — ROI estimé, plan d'action personnalisé, sans engagement.