Cas pratiques

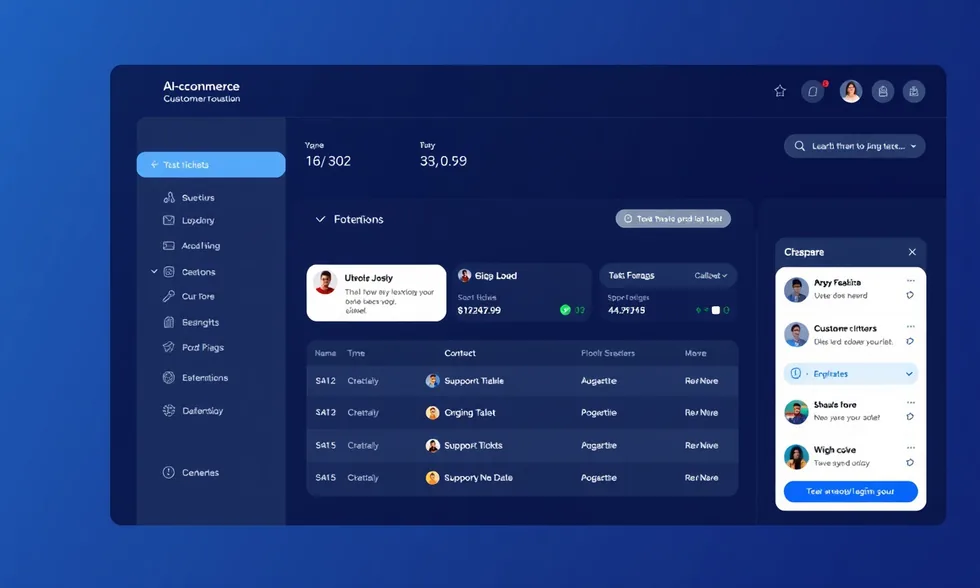

Étude de cas : e-commerçant automatise 95% des tickets SAV

Comment une boutique e-commerce de 2,5M€ CA a automatisé 95% de son service client avec un agent IA. Zéro réponse manuelle pour les demandes courantes, CSAT +18 points.

Combien d’heures votre équipe passe-t-elle chaque semaine à chercher une information qui existe déjà quelque part dans l’entreprise — dans une procédure PDF, un fichier SharePoint, un email de 2024, ou dans la tête d’un collègue disponible ou non ? Selon McKinsey, les travailleurs du savoir consacrent en moyenne 19 % de leur temps de travail à chercher et consolider des informations internes. Sur une équipe de 20 personnes, c’est l’équivalent de presque 4 postes à plein temps mobilisés uniquement pour retrouver ce qui est déjà su.

Le chatbot interne d’équipe connecté à une base de connaissances IA résout ce problème de façon directe : au lieu de chercher le bon document dans le bon dossier, les collaborateurs posent leur question en langage naturel et obtiennent une réponse synthétisée, sourcée, en quelques secondes. Cet article couvre l’architecture technique, les outils no-code disponibles, les enjeux RGPD sur les données internes sensibles, les cas d’usage les plus rentables et le ROI observé sur des déploiements réels.

La technologie qui rend cela possible s’appelle RAG — Retrieval-Augmented Generation. Le principe est le suivant : au lieu d’entraîner un LLM sur vos documents (processus long et coûteux), on conserve vos documents dans une base vectorielle et on les interroge en temps réel à chaque question posée.

Ce que cela donne en pratique : un responsable RH qui demande “Quelle est la procédure de remboursement des notes de frais pour un déplacement supérieur à 200 km ?” obtient la réponse exacte tirée de la politique interne, avec la référence au document source. Pas d’interprétation approximative, pas de réponse générique — l’information précise qui existe dans vos fichiers.

Bon à savoir : Un chatbot RAG ne “mémorise” pas vos documents — il les consulte à chaque question. Cela signifie que mettre à jour un document dans votre base suffit pour que le chatbot serve immédiatement la nouvelle version. Pas de ré-entraînement, pas de délai.

Trois outils se distinguent pour des déploiements PME en 2027 : Flowise, Botpress et N8N. Chacun a son profil d’usage.

Flowise est un outil open source qui permet de construire visuellement un pipeline RAG complet sans écrire une ligne de code. Son interface de type “flow” est particulièrement adaptée aux chatbots documentaires.

Points forts :

Hébergement : Flowise se déploie sur votre propre serveur via Docker en 15 minutes. Vos données ne quittent jamais votre infrastructure — un avantage RGPD décisif.

Botpress est adapté aux chatbots qui combinent RAG documentaire et logique conversationnelle avancée : workflows multi-étapes, escalade vers humain, formulaires intégrés. Son studio visuel permet de définir des “flows” de conversation avec des branchements conditionnels.

Un cas d’usage typique : un chatbot de support IT interne qui peut non seulement répondre à des questions documentaires (“comment réinitialiser mon VPN ?”) mais aussi créer automatiquement un ticket JIRA ou ServiceNow si la question nécessite une intervention, sans sortir de la conversation.

N8N est moins un constructeur de chatbot qu’un orchestrateur qui permet de connecter votre chatbot à l’ensemble de votre écosystème applicatif. Le nœud LangChain intégré à N8N permet de construire un agent RAG directement dans un workflow, connecté à votre CRM, votre base RH, votre ERP ou vos outils de ticketing.

Pour un chatbot commercial interne qui doit à la fois répondre sur les tarifs (documentaire RAG), vérifier la disponibilité d’un produit (API ERP) et créer une opportunité dans le CRM (API HubSpot), N8N est la solution la plus cohérente.

Astuce AutomateIA : Commencez par Flowise pour un premier déploiement RAG rapide (2 à 3 jours). Une fois les cas d’usage validés et l’adoption constatée, migrez vers N8N si vous avez besoin de connecter le chatbot à d’autres systèmes métiers. Les deux outils sont complémentaires, pas concurrents.

Connecter un LLM à vos documents internes soulève des questions RGPD sérieuses, surtout si ces documents contiennent des données personnelles (dossiers RH, fiches clients, évaluations d’employés, données de santé).

Option 1 — LLM souverain en local avec Ollama

Déployer Ollama sur un serveur interne avec un modèle comme Mistral 7B ou Qwen 2.5 permet de traiter toutes les requêtes en local, sans qu’aucune donnée ne quitte votre réseau. La qualité des réponses est inférieure aux grands LLM cloud pour les tâches complexes, mais suffisante pour 80 % des questions documentaires courantes.

Option 2 — LLM cloud avec DPA et région EU

Azure OpenAI Service hébergé dans les datacenters européens d’Azure, ou Mistral API hébergée en France, permettent de rester dans l’UE avec un Data Processing Agreement (DPA) solide. Ces configurations sont validées par la CNIL dans son guide sur l’IA et le RGPD (juillet 2024).

Option 3 — Anonymisation en amont

Si vos documents contiennent des données personnelles non nécessaires aux réponses métier, anonymisez-les avant l’indexation (suppression des noms propres, des numéros de SS, des coordonnées). Des outils comme presidio (Microsoft, open source) permettent d’automatiser cette étape.

Attention : L’indexation de documents contenant des données médicales, syndicales ou relatives aux infractions pénales est soumise à des restrictions renforcées sous le RGPD (article 9). Ne les intégrez pas dans votre base RAG sans analyse juridique préalable et base légale explicite.

Le département RH est souvent le premier à bénéficier d’un chatbot interne, pour une raison simple : les mêmes questions reviennent des centaines de fois par an. Congés, mutuelle, tickets restaurant, procédure d’arrêt maladie, politique de télétravail, onboarding des nouveaux entrants.

Notre équipe évalue vos besoins, la structure de vos documents et votre environnement technique pour vous proposer l’architecture la plus adaptée — Flowise, N8N ou solution hybride — avec un délai de mise en production de 1 à 3 semaines.

🤖 Obtenir mon audit gratuit

Un responsable RH dans une entreprise industrielle de 120 salariés en Auvergne-Rhône-Alpes a mesuré : avant le chatbot, les questions RH généraient 45 à 60 emails par semaine à traiter. Après déploiement d’un chatbot Flowise sur le règlement intérieur, la convention collective et les procédures internes : moins de 10 emails par semaine sur ces mêmes sujets. La DRH a récupéré environ 6 heures par semaine sur les tâches à faible valeur ajoutée.

Les équipes IT passent une part non négligeable de leur temps sur des demandes de niveau 1 : mot de passe oublié, configuration VPN, accès à un logiciel, problème d’imprimante réseau. Ces questions ont des réponses précises dans les guides techniques internes — mais les utilisateurs ne lisent pas les guides.

Un chatbot Botpress connecté à la base documentaire IT (guides de configuration, procédures de troubleshooting, annuaire des ressources réseau) peut traiter jusqu’à 65 % des demandes de niveau 1 sans intervention humaine, avec la possibilité de créer automatiquement un ticket d’escalade pour les cas complexes.

Ce que ça change pour l’équipe IT :

Les équipes commerciales ont besoin d’accéder rapidement à des informations précises : tarifs, conditions commerciales, délais de livraison par région, caractéristiques techniques comparées de deux produits, historique des modifications tarifaires. Ces données sont souvent dispersées dans plusieurs fichiers Excel, présentations PowerPoint et emails.

Un chatbot interne commercial connecté à ces documents permet à un commercial en rendez-vous client de poser une question depuis son téléphone (interface Slack ou Teams) et d’obtenir la réponse en 5 secondes, sans interrompre la réunion pour rappeler un collègue.

La meilleure façon d’assurer l’adoption d’un chatbot interne est de le déployer là où vos équipes travaillent déjà — et non de les obliger à se connecter à une nouvelle interface.

N8N dispose d’un nœud Slack natif permettant d’écouter les messages envoyés à un bot Slack et d’y répondre. Le workflow complet :

Pour les environnements Microsoft 365, Botpress dispose d’un connecteur Teams officiel. Flowise propose également une API REST qui peut être appelée depuis un bot Teams développé avec le Bot Framework d’Azure, ou plus simplement via Power Automate (Flow) pour les profils non-techniques.

Coût récurrent total : 50 à 190 €/mois, soit moins de 1,5 €/utilisateur/mois pour une équipe de 50 personnes.

Sur une équipe de 30 personnes où chaque membre récupère en moyenne 20 minutes par jour grâce au chatbot (recherches documentaires éliminées) :

Ces chiffres sont conservateurs — ils ne comptabilisent pas la réduction des erreurs dues à des informations obsolètes, ni l’amélioration de l’expérience employé qui contribue à la rétention.

Non. Flowise et la plupart des outils RAG acceptent PDF, Word (.docx), Excel (.xlsx), Markdown, HTML, pages Notion, pages Confluence et même des transcriptions de réunion. La qualité du découpage (chunking) est plus importante que le format : des documents bien structurés avec des titres clairs donnent de meilleures réponses.

Techniquement, il n’y a pas de limite stricte avec un Qdrant self-hosted. En pratique, une base de 500 à 2 000 documents bien sélectionnés est plus efficace qu’une base de 10 000 documents bruités. La pertinence des documents indexés conditionne directement la qualité des réponses.

Un chatbot RAG répond uniquement sur la base des documents indexés — il n’improvise pas. Si une information n’est pas dans la base, il le signale explicitement plutôt que d’inventer une réponse. C’est un avantage par rapport à un LLM générique utilisé sans RAG, qui peut halluciner des réponses plausibles mais fausses.

Pour un premier déploiement sur un corpus documentaire bien défini (100 à 300 documents), comptez 1 à 3 semaines : 2 à 3 jours pour l’indexation et la configuration, 1 semaine pour les tests et ajustements, quelques jours pour l’intégration Slack ou Teams et la formation des utilisateurs.

Les pipelines RAG modernes permettent l’indexation automatique des nouveaux documents déposés dans un dossier partagé (SharePoint, Google Drive, Notion). À chaque mise à jour d’un document, le chunk correspondant est re-vectorisé automatiquement. Il suffit de mettre à jour vos documents sources dans votre espace habituel.

Un chatbot interne d’équipe connecté à vos documents n’est pas un projet complexe réservé aux grandes entreprises. Avec Flowise ou N8N, une PME de 30 à 200 personnes peut déployer un assistant documentaire opérationnel en 1 à 3 semaines, pour moins de 200 €/mois de coûts récurrents. Le retour sur investissement est mesurable dès le premier mois, et l’adoption est naturellement forte dès lors que le chatbot est intégré dans les outils existants (Slack, Teams).

Les deux conditions du succès : des documents sources bien structurés et une politique RGPD adaptée au niveau de sensibilité des données indexées. Sur ces deux points, un accompagnement expert évite les erreurs coûteuses.

Pour évaluer la faisabilité sur votre périmètre documentaire et estimer le nombre d’heures récupérables, notre équipe propose un audit gratuit de vos cas d’usage.

🚀

Faites découvrir nos conseils experts à votre réseau

💡 Partagez nos conseils d'experts avec votre réseau professionnel

Passez à l'action

Audit gratuit en 48h — ROI estimé, plan d'action personnalisé, sans engagement.